Los 'deepfakes' ponen en riesgo la confianza en el sistema financiero de Colombia

En 2024 se registraron 74.829 denuncias por ciberdelitos, lo que representa un incremento cercano al 20 % frente al año 2023.

La ciberdelincuencia amenaza la estabilidad financiera de Colombia, que enfrenta un escenario crítico en sus sectores más estratégicos.

Según cifras de la Policía Nacional, en 2024 se registraron 74.829 denuncias por ciberdelitos, lo que representa un incremento cercano al 20 % frente al año 2023, mientras que se contabilizaron más de 36.000 millones de intentos de ciberataques, cifras que posicionan al país como el segundo más golpeado de América Latina.

Estos incidentes afectan con fuerza a sectores como la banca, la salud y la energía, elevando los costos operativos, generando pérdidas millonarias y debilitando la confianza de los usuarios.

Nuestras noticias en tu mano: únete a nuestro canal de WhatsApp y mantente informado de todo lo que sucede.

Las amenazas cibernéticas ya no se limitan al phishing o al robo de credenciales. Con la evolución de la inteligencia artificial, ha surgido un nuevo y peligroso enemigo: los deepfakes, los cuales son creaciones hiperrealistas de audio, video e imágenes que permiten a los criminales suplantar identidades con una facilidad nunca antes vista.

El riesgo es inminente: esta tecnología puede manipular procesos financieros, poniendo en jaque la seguridad y la confianza de cada transacción digital.

El impacto de la IA en los nuevos fraudes

La inteligencia artificial generativa ha democratizado el fraude. Hoy, ya no se necesitan conocimientos técnicos avanzados para crear falsificaciones de alta calidad. En cuestión de segundos, cualquier persona puede usar estas herramientas para clonar la voz de un cliente, simular la imagen de un directivo o fabricar documentos que parecen completamente auténticos. Estas capacidades ya están siendo explotadas para autorizar transferencias fraudulentas, falsificar pruebas de identidad y aprobar solicitudes de crédito ilegítimas.

Íñigo Castillo, gerente de Incode para Latinoamérica, la compañía encargada de verificación y autenticación de identidad, aseguró que el uso de la inteligencia artificial, si bien tiene un enorme potencial positivo, "también está siendo usada por los delincuentes para perfeccionar sus ataques. Los fraudes ya no se limitan a correos de phishing mal redactados, sino que incluyen contenidos digitales casi imposibles de distinguir de la realidad".

Te puede interesar: "Se pudo celebrar con tranquilidad": Char destacó comportamiento en amor y amistad

El directivo añadió que "eso cambia por completo las reglas del juego y exige a las instituciones financieras ir varios pasos adelante". Castillo cree que "Colombia puede liderar la región en innovación financiera segura", pero para ello, "necesitamos pasar de reaccionar a los fraudes a anticiparnos a ellos con IA y biometría avanzada”.

Sin embargo, en Colombia el riesgo se multiplica, gracias a que este tipo de servicios financieros digitales son cada vez más demandantes, sobre todo, billeteras electrónicas y canales de banca móvil, por lo que crece la posibilidad de que contenidos falsificados logren pasar filtros de seguridad, exponiendo no solo a las entidades a pérdidas económicas, sino que también pone en juego la confianza de los ciudadanos en el sistema financiero en su conjunto.

Para Incode, "el verdadero reto no es solo blindar transacciones, sino garantizar la credibilidad del sistema financiero colombiano, en un momento en que la confianza digital se ha convertido en el activo más valioso".

De acuerdo con Castillo, desde la multinacional han planteado cuatro acciones clave para anticiparse a este escenario:

Adoptar verificación biométrica avanzada. Identidades creadas o manipuladas con IA requieren sistemas capaces de diferenciar a una persona real de una recreación digital, especialmente en procesos como el onboarding o la originación de créditos.

Implementar autenticación continua y análisis en tiempo real. La seguridad debe acompañar al usuario durante toda su interacción con la entidad, evaluando señales de comportamiento y contexto para detener operaciones sospechosas en milisegundos.

Le puede interesar: El Covid-19, de pandemia a enfermedad endémica

Fortalecer la cooperación sectorial. Bancos, fintech y autoridades necesitan mecanismos compartidos de inteligencia de amenazas y protocolos de respuesta coordinada para reaccionar de manera efectiva.

Promover la educación digital del usuario. Enseñar a reconocer señales de suplantación —llamadas sospechosas, mensajes manipulados, solicitudes inusuales— fortalece la primera línea de defensa y refuerza la confianza en los canales digitales.

“Nuestro compromiso es que cada interacción digital en Colombia sea sinónimo de confianza y seguridad. Queremos que cada usuario y cada institución puedan relacionarse en el mundo digital con la tranquilidad de que su identidad está protegida y su futuro asegurado”, añadió Castillo.

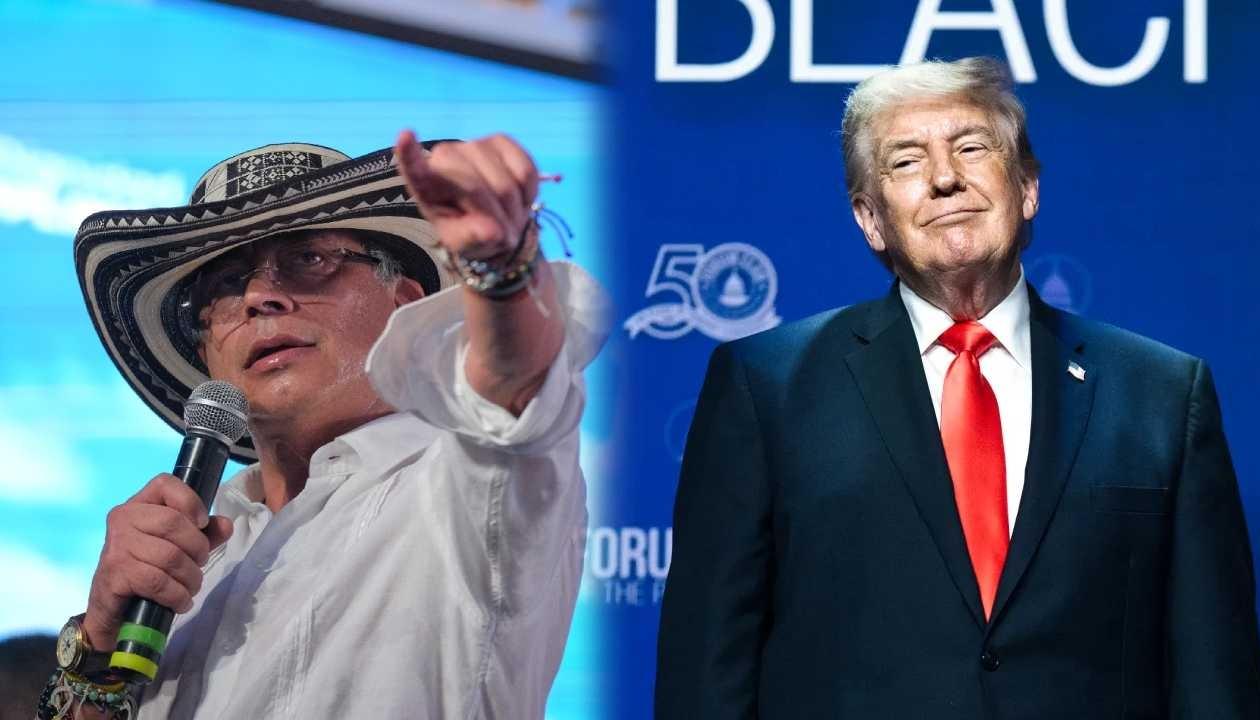

Deepfakes electorales

Con la proximidad de las elecciones, los deepfakes también se asoman como una peligrosa amenaza sobre la integridad de las campañas políticas.

Andrés Vélez, líder de seguridad informática de la Dirección de Tecnología de la Universidad del Norte, explicó cómo la inteligencia artificial generativa (IA) ha llevado la desinformación a un nivel sin precedentes, haciendo que la creación de audios, imágenes y videos falsificados sea más accesible y real que nunca.

Lea también: "2025 se perfila como un año violento para las personas LGBTIQ+ en Colombia”: Caribe Afirmativo

"Antes, era un proceso complejo y costoso", señaló Vélez. "La IA ha democratizado la creación de deepfakes, permitiendo que cualquiera, incluso con herramientas gratuitas, pueda clonar voces, simular la imagen de un candidato o manipular videos para alterar el mensaje y desinformar a los votantes".

¿Cómo detectar un deepfake?

La clave para combatir esta amenaza es la detección. Aunque la tecnología avanza rápidamente, Vélez resaltó que aún existen imperfecciones en el material generado por IA que pueden ser identificadas:

Sincronía labial: los labios del sujeto en el video a menudo no coinciden de forma natural con el audio. La falta de fluidez en el movimiento es una señal de alerta.

Parpadeo: las personas parpadean con una frecuencia natural. En los videos generados por IA, el parpadeo puede ser irregular, inexistente o tener un patrón rígido y poco realista.

Gestos corporales: los movimientos y expresiones faciales pueden parecer poco naturales o mecánicos.

Inconsistencias de iluminación y sombras: la luz puede caer de forma extraña sobre la persona o el entorno, revelando que el video ha sido alterado digitalmente.

Te puede interesar: “El talento del futbolista del Atlántico es innato, va en nuestro ADN”: Francisco Sánchez

Recomendaciones para protegerse

Vélez enfatizó que la mejor defensa es la precaución y la restricción de la información personal. "Cualquiera que tenga una presencia pública, por pequeña que sea, es un blanco potencial", afirmó. Su recomendación es clara:

Evitar la sobreexposición en redes sociales. Limitar la difusión pública de fotos y videos propios y de familiares.

Restringir la audiencia. Compartir imágenes y videos solo con grupos de confianza, en lugar de hacerlo de manera pública.

Verificar la fuente. Ante cualquier contenido sospechoso, se debe confirmar su origen a través de medios oficiales o fuentes confiables antes de compartirlo.

El especialista concluyó que la tecnología de IA sigue evolucionando y que los deepfakes, que antes tomaban mucho tiempo de procesamiento, ahora podrían ser creados en tiempo real. "Esto hace que la educación y la vigilancia sean las herramientas más poderosas para proteger la democracia y la confianza en la era digital", finalizó.